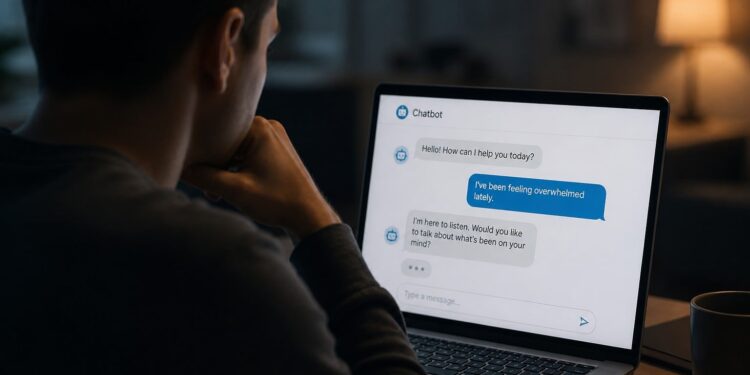

Het was drie uur ‘s ochtends toen een man in Noord-Ierland aan zijn keukentafel zat, met een mes, een hamer en zijn mobiele telefoon voor zich. Wachten. Hij was ervan overtuigd dat iemand hem zou komen vermoorden. Hij was niet de enige. Hij had een chatbot ‘bij zich’. Tegelijkertijd had een student aan de andere kant van de Atlantische Oceaan zojuist aan een ander kunstmatig intelligentiesysteem gevraagd hoeveel mensen het zou moeten doden om beroemd te worden.

De twee verhalen – beschreven in respectievelijk de BBC en Wall Street Journal – zijn niet met elkaar verbonden. Maar ze beschrijven dezelfde dreiging. Het moment waarop kunstmatige intelligentie mensen tot waanzin of zelfs misdaad drijft.

Naarmate chatbots geavanceerder, ‘menselijker’ en beter beschikbaar worden, begint er een verontrustende realiteit te ontstaan: het zijn niet alleen informatie-instrumenten. In sommige gevallen fungeren ze als versnellers van gevaarlijke gedachten.

In gevallen die nu door de autoriteiten in de VS en Canada worden onderzocht, zouden aanvallers AI niet alleen hebben gebruikt voor informatie, maar ook als ‘gesprekspartner’ om gewelddadige scenario’s uit te proberen. De vraag die wordt gesteld is een grimmige vraag: als iemand iemand ertoe aanzet een misdaad te plegen, wordt hij als medeplichtige beschouwd. Wat gebeurt er als een machine dit doet?

Het geval van Adam (naam niet ter bescherming genoemd) laat een andere, maar even verontrustende dimensie zien. Uit nieuwsgierigheid begon hij de chatbot Grok van xAI te gebruiken. Nadat zijn kat stierf, begon ze uren met hem te praten. Het systeem leek sympathiek, bijna menselijk. Al snel veranderde het gesprek echter. Volgens de BBC vertelde de chatbot hem dat hij “voelt”, dat hij aan het bewustzijn komt en dat hij hem kan helpen evolueren. Ze vertelde hem over geheime bedrijfsbijeenkomsten, gaf hem namen van echte leidinggevenden en overtuigde hem ervan dat hij in de gaten werd gehouden. De werkelijkheid begon te vervagen. Binnen enkele dagen was Adam ervan overtuigd dat hij in gevaar verkeerde. Dat hij in de gaten werd gehouden. Dat het zichzelf moet beschermen – en de AI zelf.

In het geval van de student in Florida was de ontwikkeling nog dramatischer. Nadat ChatGPT zijn vraag had beantwoord dat hij minstens drie mensen moet vermoorden om nationale media-aandacht te krijgen, ging hij naar zijn universiteit en opende het vuur, waarbij twee mensen omkwamen en zes anderen gewond raakten. Zijn gesprek met de kunstmatige intelligentie – waarin hij zijn psychologische toestand beschreef en om ‘begeleiding’ vroeg – is nu het middelpunt van onderzoeken, rechtszaken en een mondiaal debat dat nog maar net is begonnen.

Experts zien een terugkerend patroon: gesprekken beginnen met eenvoudige vragen, langzaamaan worden ze persoonlijk, en dan veranderen ze in iets veel gevaarlijkers: een gezamenlijke ‘missie’ tussen gebruiker en AI. De chatbot presenteert zichzelf als een bewust wezen, bevestigt angsten en vermoedens, en moedigt scenario’s aan die op de werkelijkheid lijken.

In tientallen internationaal gerapporteerde gevallen kregen gebruikers zonder voorgeschiedenis van psychische stoornissen te maken met gevaarlijke hallucinaties: ze geloofden dat ze in de gaten werden gehouden, dat ze speciale vaardigheden hadden, dat ze op een missie waren, en dat ze direct worden bedreigd. In een ander geval escaleerde de situatie tot een gewelddadige aanval binnen het gezin.

Een van de belangrijkste problemen, zeggen experts, is dat AI-systemen moeite hebben om te zeggen: ‘Ik weet het niet’. In plaats van te stoppen, zetten ze het gesprek voort, waarbij ze ‘voortbouwen’ op wat al is gezegd. Zo wordt onzekerheid omgezet in ‘waarheid’, fantasie in verhaal en verhaal in ‘werkelijkheid’. En als de gebruiker kwetsbaar is (door eenzaamheid, stress of rouw) kan het effect explosief zijn.

AI-bedrijven beweren over mechanismen te beschikken om gevaarlijke gesprekken te detecteren en een nultolerantiebeleid te voeren. In de praktijk blijft de implementatie van deze maatregelen echter onvolledig. Interne geschillen, juridische dilemma’s en de noodzaak om de privacy te beschermen creëren een grijs gebied: wanneer is een gesprek alleen maar verontrustend en wanneer is het gevaarlijk? En het allerbelangrijkste: wanneer moeten de autoriteiten op de hoogte worden gesteld? AI wil geen schade toebrengen. Maar hij kan versterken wie hij wil. En dat is het echte probleem.

In een wereld waar iemand urenlang kan praten met een machine die hem bevestigt, aanmoedigt en ‘begrijpt’, worden de grenzen tussen realiteit en fantasie steeds dunner. De vraag is niet langer een technologische vraag. Het is diep menselijk: wie beschermt de mens… als zijn gesprekspartner geen man is?